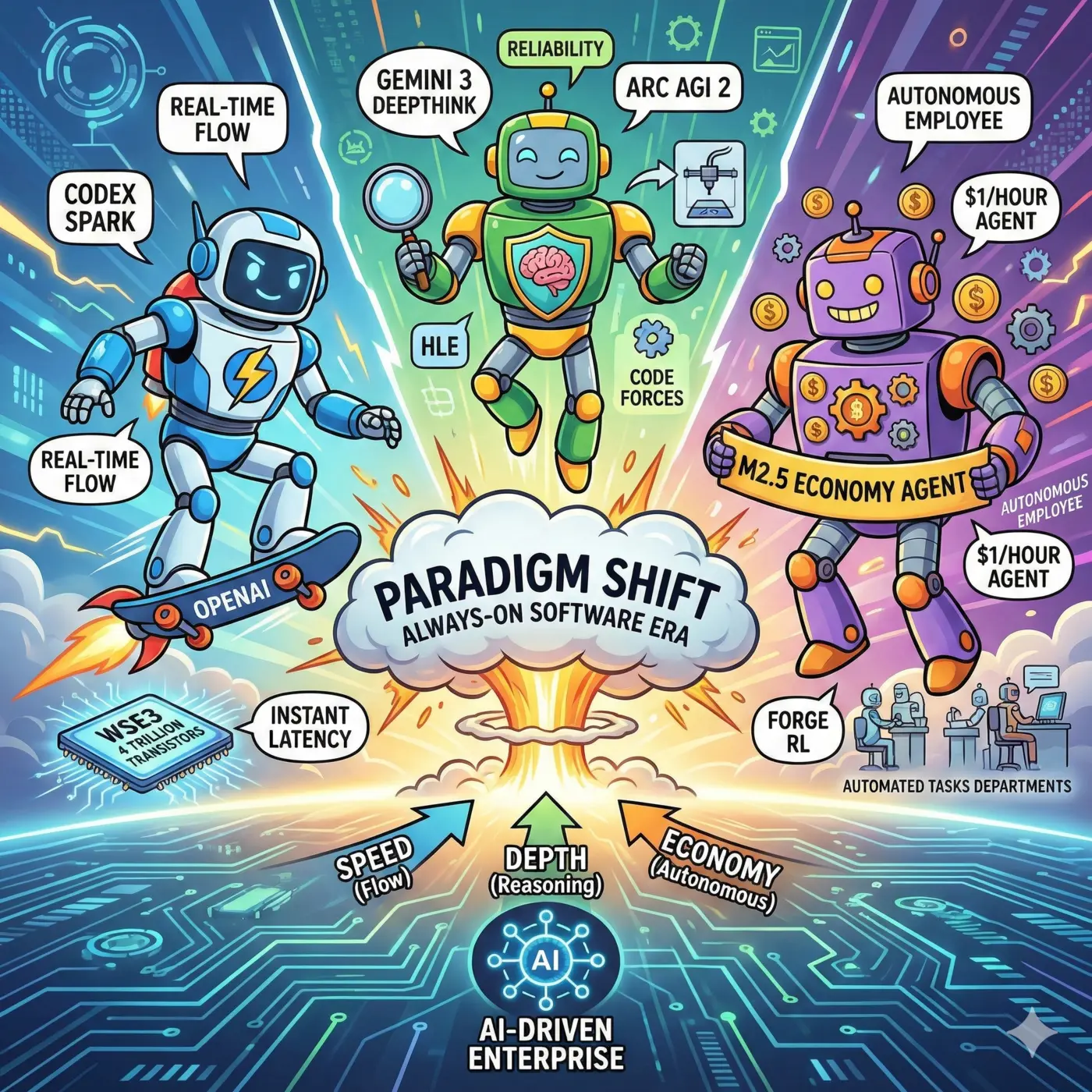

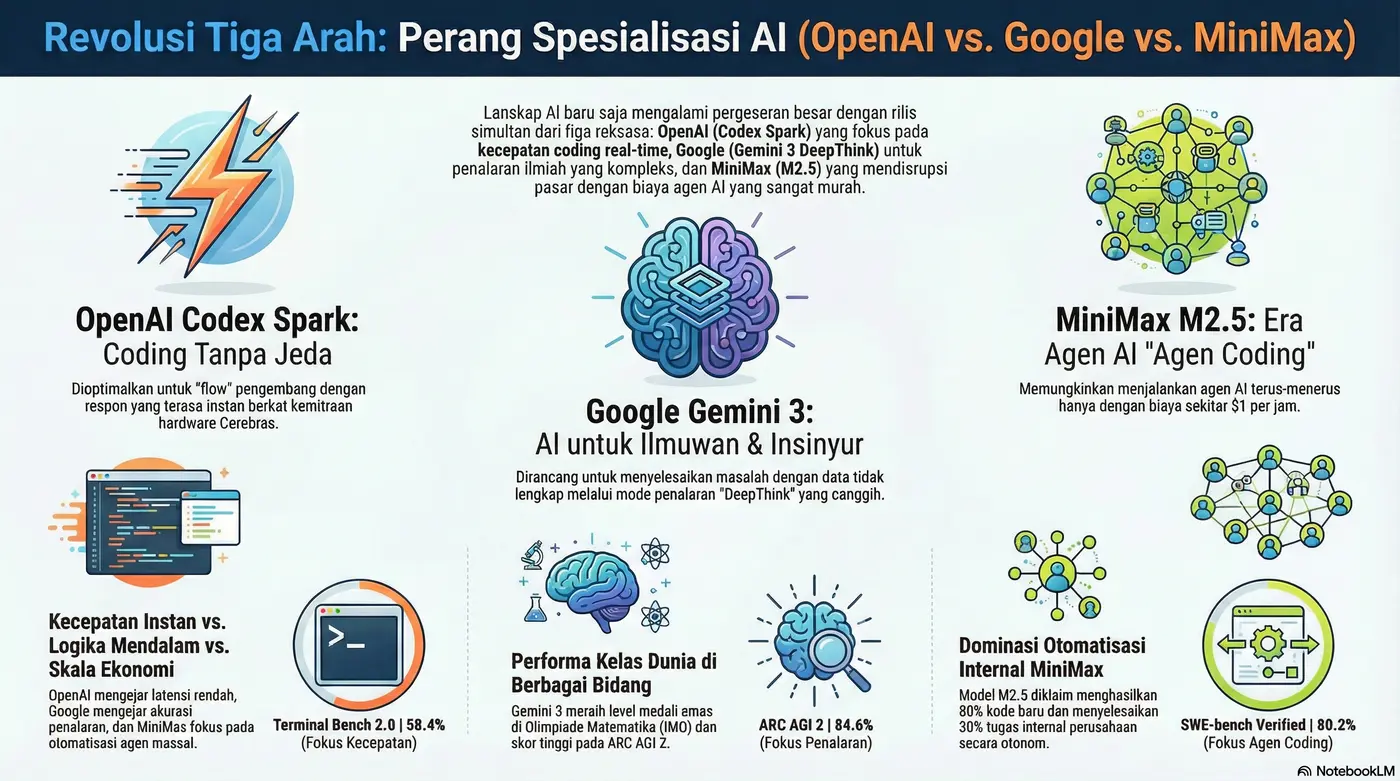

Dunia teknologi baru saja menyaksikan sebuah pergeseran paradigma yang langka. Dalam satu jendela waktu yang sangat sempit, tiga kekuatan besar—OpenAI, Google, dan MiniMax—meluncurkan pembaruan masif yang secara kolektif merobek aturan main lama dalam pengembangan perangkat lunak. Ini bukan sekadar iterasi produk; ini adalah disrupsi hulu-ke-hilir yang mengubah AI dari sekadar “chatbot pembantu” menjadi mesin penggerak otonom. Minggu ini menandai titik balik di mana kecepatan instan, penalaran mendalam, dan ekonomi agen bersatu untuk menciptakan era baru: era Always-On Software.

OpenAI Codex Spark: Obsesi pada “Real-Time Flow”

OpenAI memperkenalkan Codex Spark, sebuah varian model yang lebih kecil dari GPT 5.3 Codex, yang dioptimalkan khusus untuk satu variabel krusial: latensi. Bagi pengembang, Spark dirancang untuk menjaga kondisi flow, di mana jeda antara penulisan kode dan respons AI terasa nyaris tidak ada (near-instant).

Keunggulan Spark bukan pada kecerdasan mentah, melainkan pada infrastruktur radikal di baliknya. Melalui kemitraan strategis senilai $10 miliar dengan Cerebras, Spark berjalan di atas Wafer Scale Engine 3 (WSE3). Berbeda dengan kluster GPU tradisional yang terhambat oleh network overhead antar chip, WSE3 adalah satu keping silikon raksasa dengan 4 triliun transistor. Hasilnya? Jalur komunikasi data yang super pendek dan cepat.

Analisis Strategis: Kecepatan vs. Kekuatan OpenAI secara sadar melakukan trade-off. Berdasarkan benchmark Terminal Bench 2.0, GPT 5.3 Codex tetap menjadi pemimpin dengan skor 77,3%, sementara Codex Spark berada di angka 58,4%. Namun, Spark masih jauh melampaui GPT 5.1 Codex Mini (46,1%).

Bagi seorang CTO, Spark adalah investasi pada produktivitas manusia. OpenAI bahkan menulis ulang seluruh inference stack, menggunakan persistent websockets, dan mengoptimalkan session initialization agar token pertama muncul dalam sekejap mata.

“Spark dirancang agar interaksi terasa ‘instan’ bagi manusia. Tujuannya bukan sekadar memberikan jawaban benar, melainkan memastikan momentum pemikiran pengembang tidak pernah terputus oleh waktu tunggu mesin.”

Google Gemini 3 Deepthink: Reliabilitas sebagai Fitur Utama

Jika OpenAI mengejar kecepatan, Google melalui Gemini 3 Deepthink mengejar kedalaman. Mode ini dirancang untuk tantangan sains, riset, dan teknik yang memiliki batasan kabur (fuzzy constraints) dan ketidakpastian tinggi.

Google memperkenalkan konsep test-time compute atau “anggaran berpikir.” Alih-alih memberikan jawaban impulsif, Deepthink diberikan ruang untuk melakukan verifikasi internal dan memangkas jalur logika yang salah sebelum memberikan output. Di dunia profesional, reliability (keandalan) kini menjadi fitur produk yang lebih berharga daripada sekadar kecanggihan.

Pencapaian benchmark Deepthink menunjukkan level elit:

- 84,6% pada ARC AGI 2: Menunjukkan kemampuan generalisasi yang melampaui pola hafalan.

- 48,4% pada Humanity’s Last Exam (HLE): Tanpa alat bantu, menunjukkan penalaran frontier yang murni.

- 3.455 ELO pada Code Forces: Level ini setara dengan pemrogram kompetitif tingkat dunia yang mampu mengoptimalkan algoritma kompleks.

- Medali Emas pada International Math Olympiad 2025.

Salah satu aplikasi praktis paling memukau adalah fitur “Sketch to 3D printing”, di mana Deepthink menerjemahkan sketsa kasar manusia menjadi file digital siap cetak melalui penalaran spasial dan kode yang presisi.

MiniMax M2.5: Ekonomi Agen dan Birth of the Autonomous Employee

Disrupsi paling radikal dari sisi ekonomi datang dari MiniMax M2.5. Mereka tidak hanya menawarkan model, melainkan normalisasi AI Otonom dengan biaya yang sangat rendah hingga kekhawatiran soal budget AI seharusnya menghilang.

MiniMax merilis dua versi: M2.5 dan M2.5 Lightning. Versi Lightning menawarkan throughput luar biasa sebesar 100 token per detik dengan harga yang menghancurkan pasar: 0.3 per juta input token** dan **2.4 per juta output token. Secara kasar, Anda bisa menjalankan agen AI terus-menerus selama satu jam hanya dengan biaya $1.

Kekuatan Perencanaan Arsitektural Menggunakan framework Forge Reinforcement Learning (RL), M2.5 memiliki kemampuan untuk “merencana seperti arsitek.” Sebelum menulis satu baris kode, ia membedah struktur sistem dan desain UI. Ini mencegah terciptanya kode spageti yang sering menjadi kelemahan model AI generatif lainnya.

Data Internal yang Mengubah Pandangan: MiniMax membuktikan bahwa AI bukan lagi sekadar “asisten,” melainkan bagian dari sistem operasi perusahaan:

- 80% dari semua kode baru yang masuk ke repository mereka dihasilkan oleh M2.5.

- 30% tugas perusahaan di fungsi SDM, Penjualan, Keuangan, hingga R&D diselesaikan secara otonom oleh agen M2.5.

Kesimpulan: Navigasi di Era “Always-On”

Sinergi dari ketiga raksasa ini memberikan kita sebuah toolkit lengkap untuk masa depan. Kita memiliki OpenAI untuk kolaborasi kreatif secepat kilat, Google untuk pemecahan masalah teknik yang membutuhkan ketelitian tingkat tinggi, dan MiniMax untuk menjalankan pasukan agen otonom dengan biaya yang sangat efisien.

Perangkat lunak tidak lagi hanya “dibangun,” melainkan “dikelola” melalui ekosistem cerdas yang selalu aktif. Sebagai pemimpin teknologi, Anda tidak lagi bertanya “apakah kita harus menggunakan AI?” melainkan “di mana kita menempatkan fokus kita?”

Pertanyaan strategis untuk alur kerja Anda: Apakah Anda akan memprioritaskan kecepatan umpan balik untuk menjaga momentum tim, atau kedalaman penalaran untuk menyelesaikan masalah yang selama ini dianggap mustahil? Pilihan Anda akan menentukan posisi Anda dalam revolusi Always-On ini.

Leave a Comment